ChatGPT ist ein hoch entwickelter Chatbot, also eine Software, mit der man über ein Textfeld „Gespräche“ führen kann. Anders als virtuelle Assistenten wie Alexa oder Siri ist ChatGPT nicht dazu da, einfache Befehle auszuführen und Geräte zu steuern, und hat auch keine Spracheingabe-Funktion. Stattdessen wurde dieser Bot entwickelt, um möglichst echt wirkende Unterhaltungen zu ermöglichen: Das heisst, ChatGPT formuliert in jedem Chat neue Sätze, die sich auf das Thema beziehen, statt vorgegebene Textbausteine zu benutzen oder bestehende Abschnitte aus dem Internet zusammenzustellen (wie z. B. Google). Ausserdem speichert ChatGPT innerhalb eines Chats die schon erhaltenen Informationen, so dass man Rückfragen stellen und das System bitten kann, eine Antwort zu erklären oder anders zu formulieren. Dies führt zu einem sehr natürlich klingenden Dialog.

Maschinelles Lernen – ein aufwendiger Prozess

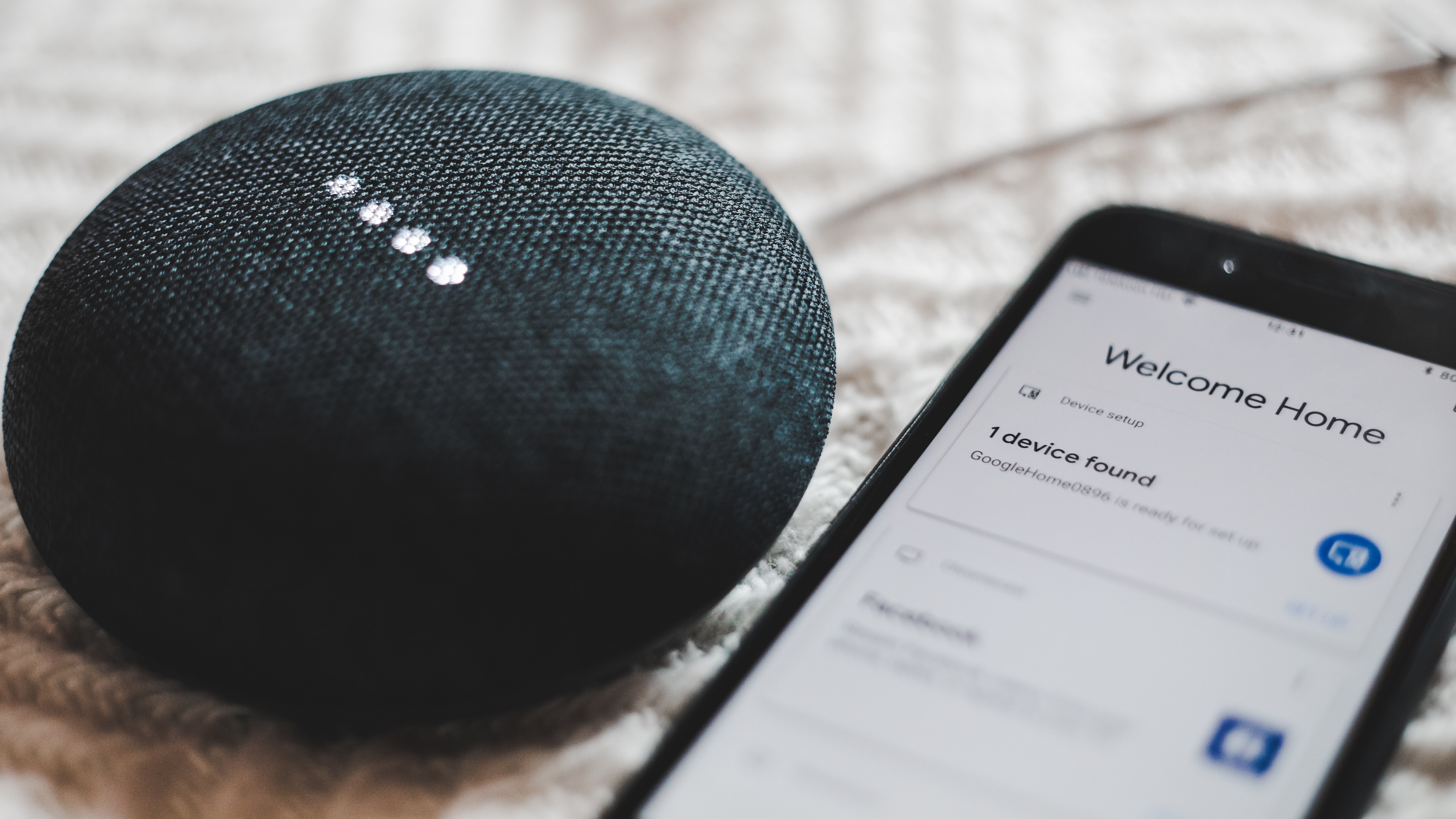

Sprachgesteuerte Assistenten wie Alexa oder Siri bedienen elektronische Geräte auf Kommando und geben vorgefertigte, manchmal witzige Antworten auf bestimmte Fragen. Ein „Gespräch“ ist mit ihnen aber nicht möglich. Bild: BENCE BOROS auf Unsplash

Trotzdem muss man vorsichtig sein, wenn man dieses System als „intelligent“ bezeichnet: Selber denken kann es nämlich nicht! ChatGPT wurde in unzähligen Lernrunden darauf trainiert, Sätze mit den wahrscheinlichsten Wörtern zu vervollständigen. Als erstes wurden dafür digitalisierte Bücher sowie ein Grossteil der Texte im Internet – wir sprechen von mehreren Hundert Milliarden Wörtern! – als Trainingsmaterial eingespeist. Diese Texte wurden von der Software statistisch analysiert. Das System lernte daraus, welche Kombinationen von Wortteilen und Wörtern am häufigsten vorkommen. Auf dieser Grundlage sollte die Software nun auf Texteingaben mit einem Output von eigenem Text reagieren, also zum Beispiel eine Frage beantworten. In mehreren Trainings-Stufen lernte sie, immer bessere Antworten zu geben: Dazu wurden ihr erst einfache Aufgaben gestellt, auf die sie jeweils das Feedback „richtig“ oder „falsch“ bekam. Ein weiteres Training erfolgte mit Hilfe einer zweiten Software, welche den Output von ChatGPT mit Dialogen verglich, die von Menschen vorgegeben waren. Aufgrund der Rückmeldung dieser Software verbesserte sich der Output von ChatGPT noch weiter.

Ein Netzwerk (fast) wie in unserem Gehirn

Beim „maschinellen Lernen“ laufen im Computerprogramm Vorgänge ab, die an die Funktion des Nerven-Netzwerks im Gehirn erinnern. Bild: CanStockPhoto

Diese stetige Verbesserung – das maschinelle Lernen – ist möglich, weil die Software von ChatGPT als künstliches neuronales Netzwerk aufgebaut ist. Ein solches Netzwerk weist Parallelen zu unserem Gehirn auf: Es lernt, indem häufig benutzte Verbindungen, die zu richtigen Antworten und Entscheidungen führen, verstärkt werden. Schlechtere Verbindungen hingegen werden unterbrochen und neu verschaltet, so dass der Output des Netzwerks insgesamt immer besser wird.

Die Basis: Statistik und Wahrscheinlichkeiten

Vereinfacht gesagt sind die Texte, die ChatGPT hervorbringt, also nicht mehr eine Aneinanderreihung von statistisch wahrscheinlichen Wörtern und Satzteilen. Umso erstaunlicher sind die flüssigen, sprachlich korrekten Antworten, die auf diese Weise entstehen: Die Datenmenge und Rechenleistung, die hinter dem Modell stehen, sind wirklich gigantisch! Sogar den sogenannten Turing-Test – benannt nach dem Mathematiker Alan Turing – würde ChatGPT sicher in einigen Situationen bestehen: Ein Mensch, der sich mit diesem Chatbot unterhält, könnte nach einem fünfminütigen Gespräch nicht in jedem Fall sagen, ob er sich mit einem Menschen oder einer Maschine unterhalten hat.

Die Feinheiten der Kommunikation

Viele Online-Shops nutzen Chatbots, die Fragen zu Produkten beantworten, Termine vereinbaren oder Reklamationen entgegennehmen. Sie sind viel einfacher programmiert als ChatGPT, der Ablauf des Dialogs ist mehr oder weniger vorgegeben (zum Beispiel reagiert der Bot oft nur auf bestimmte Stichwörter). Bild: CanStockPhoto

Doch ChatGPT ist und bleibt eine Software ohne menschliche Gefühle und Erfahrungen. Sie hat zum Beispiel Mühe mit Gesprächsformen, bei denen Humor oder Ironie eine Rolle spielen, und kann Mehrdeutigkeiten nicht erkennen. Idealerweise würde sie nachfragen, wenn eine Eingabe einen Doppelsinn hat, doch stattdessen geht sie stillschweigend von der wahrscheinlichsten Annahme aus – und kann so zu falschen Aussagen kommen. Überhaupt hängt es oft von der Formulierung einer Frage ab, ob ChatGPT sie beantworten kann. Hier zeigt sich ein allgemeines Problem beim Training einer Chat-Software: Programmiert man sie zu „vorsichtig“, verweigert sie die Antwort, obwohl sie aus den vorhandenen Datensätzen eigentlich eine korrekte Aussage generieren könnte. Beim aktuell veröffentlichten Prototyp von ChatGPT ist es oft umgekehrt: In logischen, sehr überzeugenden Sätzen präsentiert ChatGPT einen Sachverhalt, der bei genauer Betrachtung unsinnig oder einfach falsch ist. Da man – anders als bei Google – nicht weiss, aus welchen Quellen ChatGPT die Informationen zusammengestellt hat, heisst es also umso mehr aufpassen! Denn in den Trainingsdaten der Software ist die „Wahrheit“ nicht gekennzeichnet; ChatGPT gibt im Wesentlichen diejenigen Aussagen wieder, die während der Lernphase öfter vorkamen als andere.